良い3Dキャラクターを作りたいなら、まず良いリファレンス画像が必要です。

これはカッコいいAIアートを生成する話ではありません。 3Dモデリングに実際に使えるリファレンスを生成する話です。 複雑なキャラクターやプロップを制作する際の時間を節約するリファレンスです。

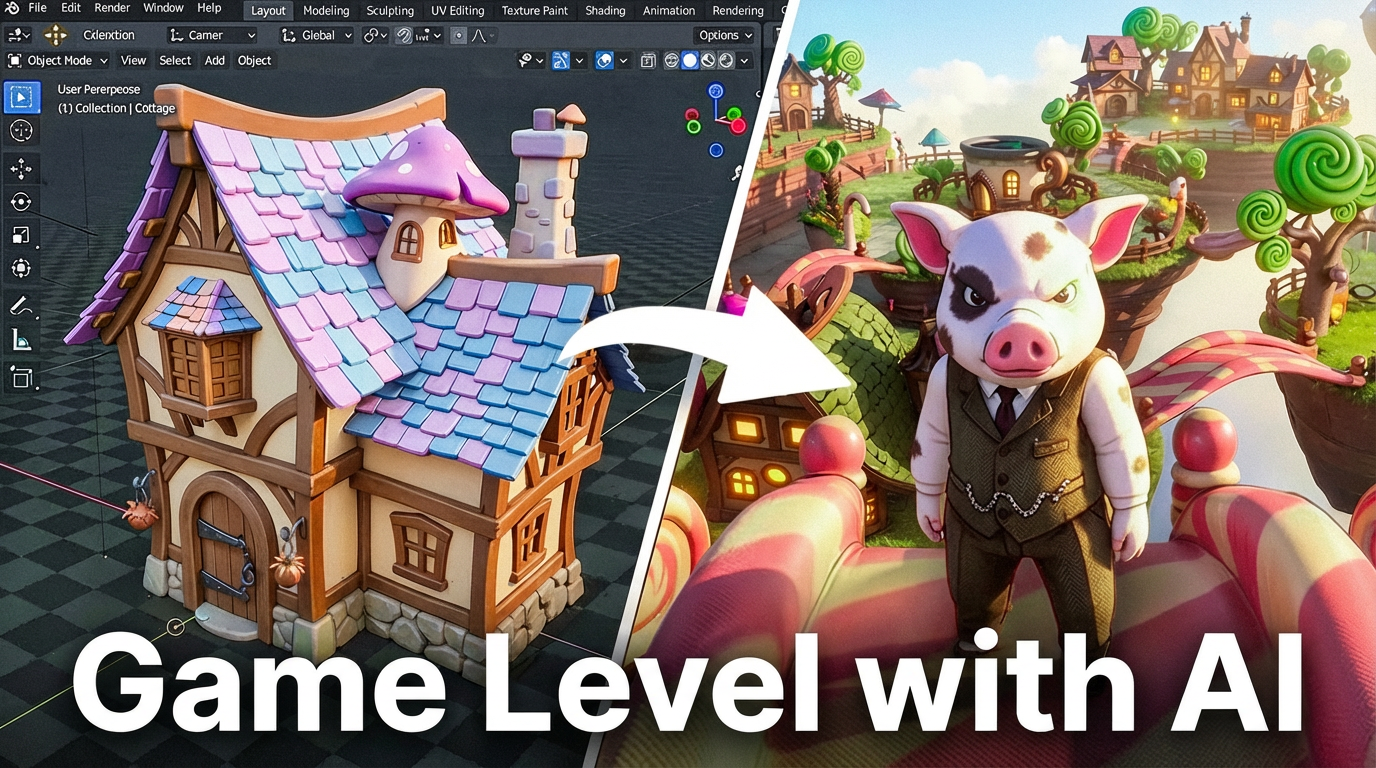

プロダクションレディなキャラクターリファレンスシートを作成するための、私の4ステップシステムを正確にお見せします。 モデリングの前に必ず使っている同じワークフローです。 実際の例として、ArcaneとPeaky Blindersのスタイルをミックスした人型子豚キャラクターを使って解説します。

このワークフローの核心はシンプルです:プロンプト用の任意のLLM(ChatGPT、Claudeなど) + 任意の画像生成モデル。キャラクターを説明し、LLMがプロンプトの 洗練を助け、画像を生成する。それだけです。

4ステップシステム

各ステップには明確な目的があります。一つでもスキップすると、後でモデルと格闘することになります。 実際にゼロから作ったキャラクターを使って、4つすべてを解説します。

アイデア出し

この段階では技術的な正確さは気にしません。アイデアだけに集中します。

まずキャラクターを詳細に説明します。性格、アーキタイプ、マテリアル、カラーパレット、雰囲気、ビジュアルの影響源。 AIがプロンプトを整理・洗練してくれるので、一貫性があり視覚的に描写的な内容になります。 そしてコンセプトイメージを複数生成します。

このキャラクターでは、人型の子豚を作りたいと思っていました。 Arcaneの手描きの美学とPeaky Blindersのファッションを ミックスしながら、Fortniteのようなスタイライズド3Dの雰囲気を保つものです。

最初の試みはうまくいきませんでした。魔法的すぎたり、プロポーションが違ったり、思い描いていた子豚と違っていました:

そこで改善しました。リファレンス写真を添付して、具体的なフィードバックを出しました:

数回のやり取りの後、コンセプトが固まりました:

最終的なブレイクスルーは、ArcaneのJinxのスクリーンショットを添付し、 AIに"copy the hand-paint style from this"と伝えた時でした。それで求めていた正確なアート方向が得られました。 スタイルリファレンスを見せることは、プロンプトの何千もの言葉よりも価値がある場合があります。

このステップは常に反復的です。生成 → 評価 → プロンプト改善 → 再生成。 LLMと画像モデルの間のやり取りがアイデア出しの核心です。 キャラクターがしっくりくるまで続けましょう。

アイデア出しには、ほぼどんな画像モデルでもうまく機能します:Midjourneyは コンセプト探索とアーティスティックなスタイルに優れ、Fluxは リアリスティックなキャラクターに向いています。Nano BananaやGeminiは スタイライズドな見た目やセルシェーディング方向に良く、Qwen画像モデルは ローカルで動作し品質も安定しています。この段階ではどれも優れた仕事をします。自分のスタイルに合ったものを使いましょう。

💡 この作業を簡素化するために使っているツール

LLMと画像ジェネレーターのやり取りがこのワークフローの核心ですが、 アプリを切り替えると摩擦が生まれます。私は Abacus AI を使っています。最新のLLMと画像モデル(Nano Banana Pro含む)のすべてに 一つのチャットからアクセスでき、月額$10です。

つまり、"refine this prompt and generate 4 variants"のように言えば、ChatGPTがプロンプトを 書き直し、Nano Banana Proが画像を生成する。すべて同じ会話内で完結します。コピーもタブ切り替えも コンテキストの喪失もありません。完全に任意です。別々のツールでもこのワークフローは可能ですが、 多くの摩擦を取り除いてくれます。

クリーンキャラクターシート

ここからは探索モードから構造モードに切り替えます。

確定したコンセプトを使って、クリーンで使いやすいリファレンス画像を生成するようにプロンプトを更新します。 ここでは明示的に以下を要求します:

- 全身 - 正しいプロポーションを確保

- Aポーズまたは Tポーズ - モデリングを容易に

- 白背景 - 切り抜きを容易に

- ニュートラルなライティング - 誤ったシェーディング情報を防止

- 極端なパースなし - 歪みを回避

パーツ(オプション)

このステップはオプションで、キャラクターによって必要性が異なります。

AIは細かいディテールに苦戦することがあります。特に顔の特徴、指、複雑なプロップなどです。 特定の要素に高い精度が必要な場合は、それを分離します。この子豚キャラクターでは、 キャラクター本体、コート、帽子を分離しました。

これは比較的シンプルなキャラクターなので、3つのパーツのみ分離しました。 しかし、複雑さに応じてさらに細かく分けることができます:

パーツを分離するタイミング:

- •頭部 - AIは全身ショットでは顔の特徴を圧縮するため、分離するとシャープなディテールが得られる

- •髪 - 特に複雑なヘアスタイルやボリュームのあるロングヘアの場合

- •手 - グローブ、指輪、包帯を巻いた拳、特定のポーズがある場合

- •武器やプロップ - 盾、剣、杖など、持っているまたは装着しているもの

- •複雑な衣装 - アーマープレート、ディテールの多いコート、レイヤードな衣服

- •機能的なパーツ - 3Dで独立して制御したいもの(例:取り外し可能なヘルメット、開閉可能なコート)

ロジックはシンプルです:3Dでキャラクターの一部を制御したい場合は 分離する。制御する必要のないシンプルな要素であれば、スキップして構いません。 ステップ2のクリーンシートで十分です。

ビュー

クリーンシートとオプションのパーツの後、正投影スタイルのビューを生成します。 この段階ではもう探索はしていません。リファレンスのエンジニアリングをしています。

3つのビューすべてが常に必要なわけではありません。実際に必要なビューだけを作成してください。 制御したい具体的な要素があるビューだけです。

例えば、背面ビューを作成したのは、キャラクターにピグテールが あるかどうかを制御する必要があったからです。背面リファレンスがなければ、 3Dジェネレーターが勝手に追加してしまう可能性があります。 シンプルなオブジェクトの背面、例えば無地のコートの背面など、気にしない場合は そのビューを完全にスキップできます。

ビューを作成する場合、以下の目的で重要です:

- あらゆる角度からの正確なプロポーション

- ディテールの制御 - 3Dジェネレーターが追加する可能性のある不要な要素を防止

- ビュー間での衣装/アーマーの一貫した厚み

🎯 最終3D結果

これらのリファレンスシートを使い、Tripo AIで最終3Dモデルを生成しました。 出力の品質はリファレンスの品質に直結します。それがこのシステムの核心です。

✅ クイックまとめ

アイデア出し

自由に探索する。コンセプト、シルエット、スタイルを確定させる。ポーズや背景は気にしない。

クリーンキャラクターシート

全身、ニュートラルポーズ、白背景、ニュートラルライティング。これがモデリングリファレンスになる。

パーツ(オプション)

複雑な要素(武器、頭部、アクセサリー)を分離して高精度なリファレンスを得る。

ビュー

フロント、サイド、バック - コンセプトアートを構造的なモデリング設計図に変える正投影ビュー。

より良い3D結果を得たいなら、まずリファレンスワークフローを改善してください。 ほとんどのモデリングの問題はリファレンス段階から始まっています。

Stefan Vaskevich

Stefan Vaskevich