AI 3Dモデル市場は 2026年に$1.16B規模で、2035年までに$12.1Bに達すると予測されており、CAGRはおよそ19%です。出典は 360iresearch と Global Growth Insights。その需要の44%はゲームとエンターテインメントです。インディークリエイターにとっての問いは、1年前から「AIが従来の3Dを置き換えるか」ではなくなりました。問いは月曜日にどのスタックで出荷するかです。

この6ヶ月、私はこれに取り組んできました。新しいAI 3Dツールが出るたびに、実際のエンジン受け渡しに耐えなければならない実在のキャラクターでテストしてきました。静止のターンテーブルでもなく、マーケティング用のレンダーでもなく、Unreal Engine 5でTポーズのドリフトもクリッピングもなくアニメーションするリグ済みキャラクターです。パイプラインを徹底的に検証するために使ったキャラクターは Plague Doctor Demon Hunterで、以下の各ステージで登場します。

従来のサブスクリプションスタックは合計するとあっという間に膨らみます。ZBrushは 月額$49、Substance 3D Texturingは 月額$24.99、Mayaは 年額$1,545。1キャラクターも出荷する前に年間およそ$2,000です。下記の無料スタックは、それと並べても通用するアウトプットを生み出します。この記事の最後には、ツールリストではなく連結されたパイプライン全体が手に入ります。私たちは /arena と /leaderboard で結果をキュレーションしているので、自分で内容を検証できます。

高品質な3Dキャラクターのコンセプトを無料で生成するには?

コンセプトが最初に来るのは、下流のすべてがリファレンスにあるものを増幅するからです。弱いコンセプトは弱いメッシュになり、弱いテクスチャになります。解決策はMidjourneyのサブスクリプションではありません。解決策は Google AI Studioの無料枠でNano Bananaモデルを動かすことです。

Nano Bananaは複雑なマルチパートのキャラクターをうまく扱えます。Plague Doctorでは1行のプロンプトから始め、チャットで反復しました。帽子を外す、クロスボウを追加する、シルエットを引き締める、レザーを暗くする。自然言語による精緻化のループが、これが静的なプロンプト・トゥ・イメージ生成器を上回る理由です。白いキャンバスや、もっとシャープだったらいいのにというラフスケッチから始めるのではなく、最終的な3Dモデルの複雑さをすでに規定するプロダクション水準のリファレンスから始めます。

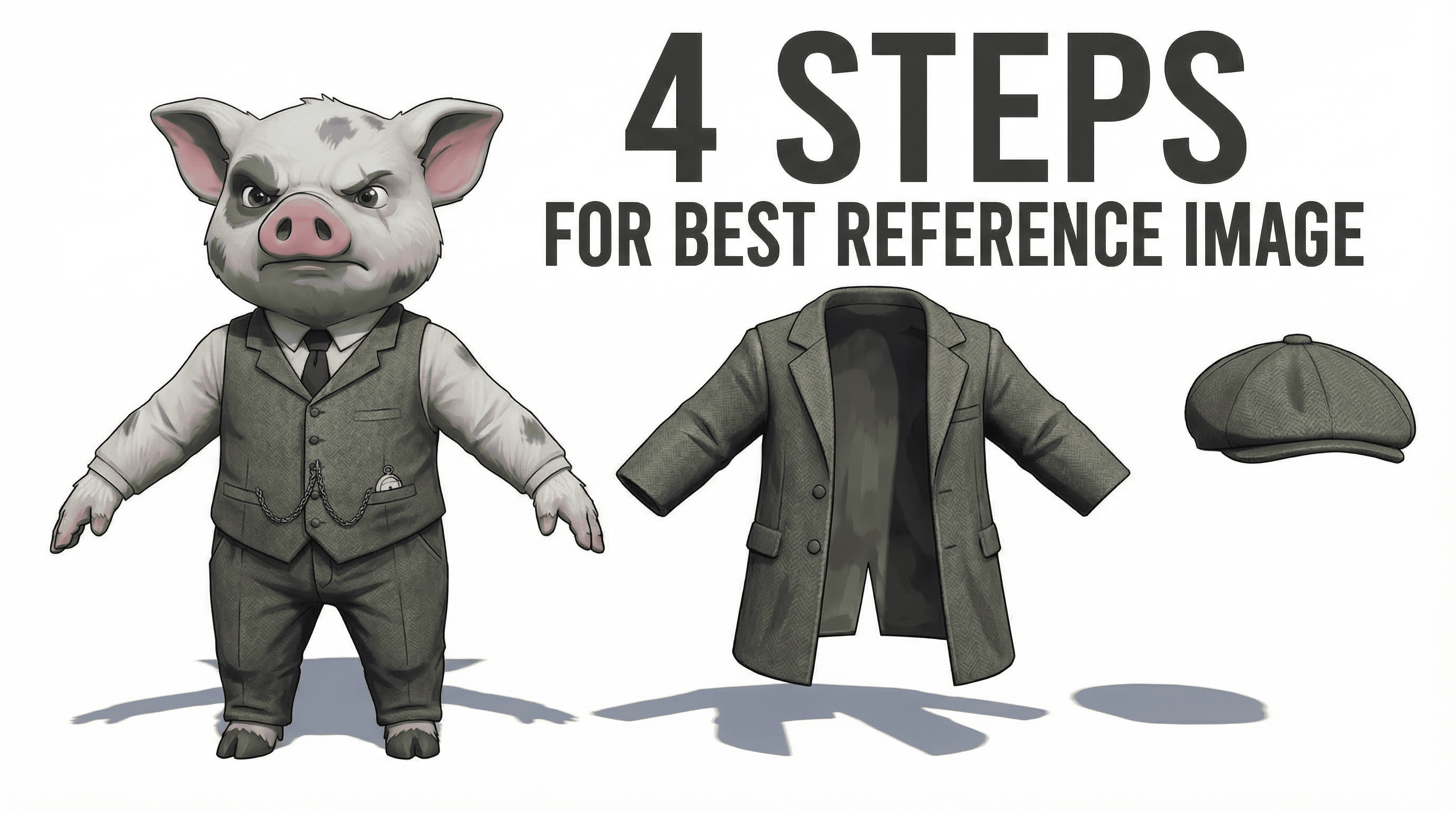

多くの人が見落とすコツ。3Dメッシュを生成する前にキャラクターをパーツに分割することです。Plague Doctorは9つの個別アセットに分けました。ボディ単体、手、ブーツ、オーバーコート、クロスボウ、ベルト、帽子、髪、マスク。各パーツは独自のNano Banana生成パスを通り、多くの場合フルキャラクターのリファレンスに対する単一アセット抽出プロンプトとして実行します。この決定は、後で動いて反応するもの(オーバーコート、髪、マスク)と、ボディのシルエットに焼き込まれるものを制御します。複雑なキャラクターはパーツを多めに、シンプルなキャラクターは少なめに分割します。適切な粒度は2〜3キャラクター作るうちに身につきます。

“無料版でも非常に高性能です。Nano Bananaが発表された日には、すでに非常に良かった。”

最初の3回のイテレーションできれいな結果を得るプロンプト戦略は、 最高の3Dキャラクターリファレンスを作る方法の詳細解説を参照してください。あの記事は、コンセプトを3Dジェネレーターに渡す前に整えたいビュー別のセットアップ(フロント、3/4、サイド、バック)を扱っています。

ステージ2:Hunyuan 3D Studio 3.1でAIメッシュ

メッシュステージはパイプライン全体のエンジンです。私は Hunyuan 3D Studio 3.1でこれを実行します。80〜90%プロダクションレディなクアッドベースのベースメッシュを生成します。ワイヤーフレームは十分にきれいで、リトポロジーは一からの再構築ではなく仕上げのパスになります。グローバル版の無料枠は20回の生成、中国版は最大30回。どちらも複数のキャラクターを出荷するのに十分です。

私はスタジオ内のキャラクターワークフローで作業します。普段使うのは単一画像入力です。マルチビューも使えますし、賢そうに聞こえますが、私は前面のビューでうまく記述できない背面の何か特定のものをロックする必要があるときだけ手を伸ばします。ほとんどのアセットでは、単一画像のほうがクリーンなジオメトリが得られます。このステージではジオメトリだけを生成します。テクスチャは生成しません。本気で取り組んでいるので、いまHunyuanに求めるのは、その上に構築するためのきれいなトポロジーだけです。

誰も言わないプロのコツ。最初の生成を受け入れないこと。私はキャラクターごとに3〜4パスを実行し、最もきれいなワイヤーフレームを選びます。試行ごとのばらつきは実在し、最初の結果は通常ベストではありません。15分余分にかかりますが、下流で2時間のクリーンアップを節約できます。

“中程度の複雑さのアセットには100%十分なことは決してありません。秘訣はAIが生成したメッシュを高品質なベースとして使うことです。”

ステージ3:Blenderでスカルプトクリーンアップ

ここでBlenderが登場しますが、ほとんどのチュートリアルが想定する使い方ではありません。私はゼロからスカルプトしているわけではありません。AIが生成したパーツを1つの一貫したシルエットに整え、不完全な箇所を直し、ジェネレーターが残した穴を塞ぐために、ごく少数のツールを使っています。私たちはあらゆるブラシをテストし、あらゆるワークフローを議論し、答えは驚くほどシンプルでした。4つのツールファミリーが、実際に必要なほぼすべてをカバーします。

1つ目のファミリーはGrabブラシとその親戚のElastic Grabです。これは私が80%の時間使うブラシです。デジタル粘土ツールです。オーバーコートを押し込む、肩を前に引っ張る、右手の少しずれたポーズを直す。AIが生成したキャラクターはしばしば別々に感じられるパーツ(ブーツ、マスク、オーバーコート、クロスボウのストラップ)として出てきます。GrabとElastic Grabで5〜10分でプロポーションを調整しシルエットを統一できます。

2つ目のファミリーはマスキングです。投げ縄マスクとマスクブラシがあり、どちらもパーツを正確に選択できます。マスクメニューの中にはカットマスクオプションがあり、きれいなカットを作って穴を埋めるので、新しい境界でスカルプトを続けられます。用途:別のオブジェクトに覆われるパーツを除去(マスクの下の頭、ブーツの下の脚)、ブーツが別途入るので足をカット、手が別途入るので腕をカット、または別々の生成の良い部分を1つのボディに合体させる。

3つ目のファミリーはスムーズブラシです。当たり前に聞こえますが、用途は具体的です。マスクで覆われるので頭をスムーズにします。決して見られないジオメトリの下にディテールをスカルプトする必要はありません。

4つ目のファミリーはInflate+Remeshです。これは穴埋めのコンボです。エディットモードは複雑な穴を塞ぐのにひどい。Inflateブラシが縁の周りにボリュームを足し、Remeshがトポロジー全体を再計算して穴を自動的に閉じます。適切なRemesh値はテストで見つけます。下のトポロジーも溶かしますが、ステージ4のリトポロジーがきれいに作り直すので問題ありません。

“私が挙げたこの4つのシンプルなものだけで、どんな結果でも90%は達成するのに十二分です。”

AIがボリュームを与えてくれました。次にトポロジーをエンジンレディにします。Blenderが専用のAIスカルプトツールの隣でどこに位置するかをもっと深く知りたい場合、 スカルプトのためのトップ3 AIモデルの比較がそのトレードオフを扱っています。

ステージ4:Hunyuan自動+Retopoflowでリトポロジー

リトポロジーはかつてパイプラインで最も長く、最もスキル依存の地道な作業でした。今ではほぼ自動化されています。私はクリーンアップ済みのオブジェクトを1つずつエクスポートし、Hunyuan 3D Studioのリトポロジーツールに戻します。ターゲットの面数(low、medium、high)とクアッドを選びます。気に入るワイヤーフレームが得られるまで、通常はオブジェクトごとに3〜4回生成します。中程度の複雑さのアセットでは100%十分なことはほとんどありませんが、ゲームレディなトポロジーまでの80〜90%まで連れて行ってくれます。

残りの10%は精密な作業で、 Retopoflowがそれを処理するBlenderアドオンです。Retopoflowは商用利用しない限り無料です。対称なら、まずミラーし、片側を直し、ミラーで戻します。手作業の手直し時間を大きく節約できます。

Retopoflowにはツール一式が揃っていますが、ほとんどは使いません。重要な3つはPolypen、Relax、Contourです。Polypenは個別のクアッドを追加・移動するため。Relaxはサーフェスに沿ってトポロジーを滑らかにするため。Contourはカーブした領域の周りのループをきれいにするため。これらが最も重要になる場所は、関節(肩、肘、膝)の周りのループと目の周りです。そこは変形が起きる領域です。そこのトポロジーが悪いと、キャラクターがアニメーションした瞬間に表面化します。

“Polypen、Relax、Contourの3つのツールをマスターするだけで、関節と目の周りのループを数分で直せます。”

手作業のクリーンアップ前にどのAIツールが最もきれいなトポロジーを生成するかの並列データは、 リトポロジー比較2025のテストを参照してください。Hunyuanはジオメトリ配分でそのテストに勝ちました。

ステージ5:Hunyuan自動UV+UV PackmasterでUV展開

UV展開はかつてリトポロジーに次ぐ2番目に苦痛なステージでした。AI自動UVが、シンプルなオブジェクトについてはほぼ気にならない作業に変えてくれます。ワイヤーフレームを直したら、オブジェクトをHunyuan 3D Studioに戻して自動展開ツールを通します。よりシンプルな形状(ボディ、帽子、ベルト)では結果は素晴らしいです。メッシュステージと同じく、ベストを選ぶために何回か再生成します。

“これがAIが私のボディを展開する様子です。素晴らしいと思います。”

複雑なオブジェクトでは、自動UVは完全に失敗することがあります。私の場合ブーツが失敗しました。そうなったらBlenderにフォールバックします。ワイヤーフレームの自然なエッジに沿ってシームをマークし、展開します。ステージ4のトポロジーがきれいなら、シームを引くのは5分の作業で、30分の地道な作業ではありません。正直なところ、リトポロジーがきちんとされている限り、UV展開はパイプライン全体の中でおそらく最も簡単な作業です。

初心者の多くがスキップするステップはパッキングです。Blenderデフォルトのpack-islandsはプロダクションには不十分です。 UV Packmasterという無料のBlenderアドオンを使ってください。ターゲットのテクスチャ解像度に紐付いた設定可能なピクセルマージンで、UVアイランドを密に詰めます。Plague Doctorではボトルとクロスボウを手動で展開し、ボディと共有のテクスチャセットにパックしました。それは、専用の2Kや4Kマップが不要なオブジェクトに対して行うことです。Blender組み込みのパッカーはテクスチャ空間を無駄にしますが、UV Packmasterは無駄にしません。

ステージ6:ノーマルマップとアンビエントオクルージョンマップをベイク

UVがきれいになったら、ベイキングの準備が整います。ベイキングのポイントは、ハイポリメッシュからの目に見えるディテール(あらゆるシワ、あらゆる折り目、あらゆるハードエッジ)を、ローポリメッシュがランタイムで読めるテクスチャマップに転写することです。キャラクターごとに2つのマップをベイクします:ノーマルマップとアンビエントオクルージョンマップ。これらがないと、ローポリキャラクターはローポリキャラクターに見えます。

“これはおそらく、ソフトウェアの中で完全にやることを本気で勧められる唯一のステップです。学ぶのが非常に簡単で、本当に良い結果が出るからです。”

Blenderのプロセスは知ってしまえば機械的です。レンダーエンジンをCyclesに切り替えます。ハイポリオブジェクトを選択し、シフト+クリックでローポリオブジェクトを選んでアクティブ選択にします。ベイクパネルを開き、マップタイプ(NormalまたはAO)を選び、Selected to Activeオプションを有効にし、押し出しとレイ距離を妥当なデフォルトに設定し、シェーダーエディタでターゲットの画像テクスチャが選択されていることを確認し、Bakeを押します。1分後にはノーマルマップが手に入ります。AOも同じ手順で繰り返します。キャラクターのすべてのオブジェクトについて同じプロセスです。

AOはパイプライン全体で私のお気に入りのマップです。色のテクスチャでは絶対に作れない深みを加えます。ガントレットが手首に出会う場所に住む影、帽子のつばの内側の暗さ、オーバーコートのパネル間のシーム。それらすべてはAOから来ます。

“CGIにおいて、アンビエントオクルージョンは私のお気に入りのマップです。色テクスチャがなくてもオブジェクトをリアルに見せられるからです。”

より速く、よりクリーンなベイクワークフローが欲しい場合、 Marmoset Toolbagが私が勧めるツールです。Blenderのベイカーより使いやすいです。ベイクプロジェクトを作り、ハイスロットにハイポリメッシュを投入し、ローポリスロットにリトポロジー済みメッシュを指定し、マップと出力解像度を選ぶと、Toolbagはほぼ瞬時にすべてをベイクします。1パスでノーマル、AO、カーブ、ポジション、その他いくつかをベイクできます。Toolbagは有料ですが、プロダクション作業ではすぐに元が取れます。無料スタックにこだわるならBlenderで問題ありません。

なぜプロダクションのテクスチャリングではModddif Albedo ModeがMulti-Viewに勝るのか?

テクスチャリングはほとんどのAIキャラクターパイプラインが崩れる場所です。AIテクスチャツールのデフォルトの失敗モードは、ライティングをディフューズマップに焼き込むことです。プレビューウィンドウでは見栄えがします。しかしアセットをUnreal Engineに落とした瞬間に壊れて見えます。エンジンの実際のライティングが、テクスチャに既に塗り込まれたライティングと戦うからです。

私のベースレイヤーは2つの場所のいずれかから来ます。シンプルなオブジェクト(ボトル、ベルトのバックル、小道具)はHunyuan 3D Studioにアセットをテクスチャリングさせ、その結果をBlenderに出発点として落とします。ハイエンドな作業にはTripoがより良いデフォルトテクスチャを与えてくれます。しかしそれはワークフローを変えません。率直に言って、より良いテクスチャをこれまでで提供する有料のTripoがありますが、いずれにせよModddifに行ってそこで直すことになります。ベースがHunyuan、Tripo、あるいはどこでもないとしても、実際のテクスチャリングは Modddifの中で起こります。

Modddifの中には重要な2つのレンダーモードがあります。RealisticとAlbedoです。Albedo Modeはフラットなカラーマップを生成します。焼き込まれたハイライトなし、焼き込まれた影なし、反射なし。純粋なディフューズです。それがUE5が実際に欲しいものです。PBRシェーダーがランタイムでライティングを行います。色を渡せば、残りはやってくれます。

“Albedoモードは実プロダクションにとってのゲームチェンジャーです。焼き込まれた光や反射のないフラットなカラーテクスチャを作れます。”

Modddifの中の2つ目の決定ポイント:Single-View vs Multi-Viewプロジェクション。Multi-Viewはすべてのカメラアングルにわたって一度に投影しようとします。賢く聞こえます。実際には複雑な領域で幻覚します。特に顔。目がドリフトし、頬骨の輪郭が滲み、肌のトーンがアングル間で変わります。代わりにSingle-Viewを使ってください。

Single-Viewは1つのカメラアングルからテクスチャを投影し、残りはパッチングブラシで直します。リファレンス画像を選び、フロントから投影を生成し、3/4に回転、サイドに回転と進めながら、不完全な箇所にパッチを当てます。パッチングブラシはインペイント領域と画像プロンプトを取ります。悪い領域を塗ると、その領域だけを再描画します。ボディのリファレンスが頭をうまく記述しない場合、顔用に別のリファレンスを使えます。それからカラーテクスチャをBlenderにエクスポートし戻します。

私がよく使うもう1つのコツ:Blenderのテクスチャペイントモードのステンシルブラシです。Modddifがテクスチャの95%を処理しますが、ロゴ、パッチ、テキストを上に追加する必要があるときがあります。ブラシ設定でTextureタブを開き、適用したい画像(ステッチ、パッチ、ロゴ)を読み込み、マッピングモードをStencilに切り替えます。これで右クリックでステンシルを位置決め、シフトでズーム、コントロールで回転、クリックでサーフェスにペイントします。この1つのツールで、AI生成テクスチャの上に任意のロゴ、デカル、テキストを追加できます。クローンブラシ(コントロール+ピックでソース領域、その後ペイントで他の場所にコピー)と、軽微な不完全さを直すためのスメアブラシもあります。Blenderはこのすべてを無料で行います。Substance Painterはそのワークフローが好みなら有料の代替です。

パッチングブラシのセットアップと私が使う投影設定を含むModddifの完全ウォークスルーは、 Modddifによる AIテクスチャリングを参照してください。それがこのセクションと対になる詳細解説です。

ステージ8:Blenderシェーダーで全マップをコンポジット

Modddifがカラーをくれます。ベイクがノーマルとAOをくれます。今度はあと3枚のマップが必要です:ラフネス、メタリック、そして(オプションで)エミッシブ。それからすべてをBlenderのPrincipled BSDFノードツリーに通します。これを独立したステップとして扱うのには理由があります。スキップすると、どんなに良いカラーテクスチャでもキャラクターはフラットでプラスチック的にレンダリングされます。

“私はこれをコンポジショニングのステップと呼びます。すべてのマップを1つにまとめるからです。”

ラフネスとメタリックは値マップです。両方とも白黒のテクスチャです。考え方:ラフネスはサーフェスがどれだけマットか光沢かで、メタリックは金属のように振る舞うかどうかです。黒のテクスチャから始め、Principled BSDFノードのRoughness入力に差すと、黒はゼロのラフネスなのでオブジェクト全体が鏡のように光ります。塗りつぶし操作で値を中間グレー範囲のどこかに設定し、妥当なデフォルトに戻します。それからエディットモードに入り、より反射的であるべき領域(眼鏡、金属のバックル、レザーのハイライト)を選択し、ラフネスマップ上のそれらのUV領域を暗い値で塗りつぶします。メタリックマップも同じアプローチ:黒から始め、実際の金属領域(ガントレットのプレート、クロスボウのトリガー機構、ベルトのリベット)を白で塗り、それ以外は黒のままにします。

エミッシブはオプションです。キャラクターに光るパーツ(ルーン、魔法の目、テック)があるなら、その領域をエミッシブマップに塗ります。Principled BSDFノードのEmission入力に差します。シェーダー内の単一の値スライダーから強度を駆動できます。

それから完全なシェーダーをコンポジットします:Modddifからのカラーをベースカラーへ、ベイクからのノーマルをNormal Mapノード経由でNormalへ、AOは別チャンネルとしてあるいはゲームエンジンが期待する形でベースカラーに乗算、ラフネスをRoughnessへ、メタリックをMetallicへ、エミッシブをEmissionへ。Substance Painterは有料ツーリングでこれをエンドツーエンドで行います。Blenderは同じ最終結果を無料で行います。

ステージ9:AccuRig+Blenderウェイトペイントでリギング

リギングは紙の上では最も怖いステージです。技術的に見え、遅く見え、ツールは歴史的にアニメーター以外には冷たかったからです。良いニュース:恐怖は実際の作業より大きいです。最低限のウェイト分布、ボーン、スケルトンの仕組みを学んでしまえば、結局のところメッシュのどの部分がどのボーンに従うかをエンジンに伝える作業に帰着します。

私はキャラクター単体(まだ別の付属品なし)をTポーズかAポーズでエクスポートし、 AccuRigで開きます。マーカー配置のワークフローはキャラクターあたりおよそ15分です。各主要関節(肩、肘、手首、股、膝、足首)と指の関節それぞれにマーカーを置きます。配置が良いほど自動ウェイト分布が良くなります。

よくスキップされるステップはキャリブレーションです。マーカーを置いた後、AccuRigはボディに対してリグをキャリブレーションするよう求めます。キャラクターが非標準のプロポーション(Plague Doctorの長いオーバーコートの袖、ワイドブリムの帽子、ごついブーツ)を持つ場合、キャリブレーション後に腕、手、脚が自然に見えることを確認する必要があります。このステップをスキップすると、自動スケルトンがボディから外れます。これはまさにMixamoがスタイライズされたキャラクターで破綻する失敗モードです。AccuRigはここでMixamoより優れていますが、それは実際にキャリブレーションを実行した場合だけです。

AccuRigは有料アニメーションも提供しますが、必要ありません。エクスポートはクリーンなターゲットスケルトンを使い、Unreal Engine 5やUnityにそのまま入ります。エンジンに入れば既存のアニメーションをキャラクターにリターゲットします(ステージ10で扱います)。Mixamoスケルトンもインポートできますが、ターゲットエンジンのスケルトンが常に好まれます。

手作業の半分は譲れません。AccuRigが終わったら、リグ済みキャラクターをBlenderで開き、ウェイトペイントにおよそ30分費やします。問題のほとんどは2か所に集中します。脇の下。肩のウェイトが胸に染み出します。そしてオーバーコート系のジオメトリ。ヒップ回転で緩い布が脚に貫通します。少数のウェイトペイントツール(グラデーションツール、スムーズツール、値ペイントツール)を知っていれば、両方を直すのに十分です。

“ほとんどの問題は脇の下や、オーバーコートのようなオブジェクトに集中しています。”

後で物理が必要なパーツ(オーバーコート本体、しっぽ、髪)には、Blenderで追加ボーンを足し、グラデーションウェイトペイントツールでウェイトをそれらの間に分配します。Plague Doctorではオーバーコートの内側に2列のボーンを足し、キャラクターが走るときに揺れるようにしました。それが静的なメッシュをモーションに反応するものに変える方法です。

“静止画では問題ないモデルと、アニメーションパスに耐えるモデルの差です。”

正直な数字:私のPlague Doctorはとくに複雑な形状をしていないので、リギングは30分でした。複数の布レイヤー、小道具、変わったシルエットを持つ複雑なキャラクターはもっと時間がかかります。それに合わせて期待値を設定してください。AccuRigは人型キャラクターを扱います。動物、クリーチャー、4足リグはワークフローが異なります。 動物のためのAIリギング(Animate Anything)のガイドがそのパスを扱っています。

ステージ10:Unreal Engine 5でのエンジン統合

最後のステージはほとんどのAI 3Dデモワークフローを篩い落とすステージです。ほとんどのデモはここで死にます。ディフューズに焼き込まれたライティング、しくじったベイクからの壊れたノーマル、スケルトンがリターゲットしたときのTポーズドリフト、UE5のPBR入力に正しくマップしないマテリアル。Plague Doctorが通ったのは、各前のステージが正しく行われたからです。

UE5内のワークフローは短いです。3人称テンプレートから新規プロジェクトを作ります。キャラクターをインポートします(AccuRigスケルトン、マテリアル接続済みのFBX)。キャラクターをレベルに配置し、ステージ8でコンポジットしたマテリアルを正しいマテリアルスロットに割り当てます。

次にリターゲティングです。UE5には2つの標準スケルトン、MannyとQueenie、それに付属するロコモーションセットが同梱されています。IKリターゲッターを開き、片側を標準スケルトンに、もう片側をAccuRigスケルトンに向けると、UE5がボーン階層をマップします。数秒後にはMannyやQueenieのアニメーションをカスタムキャラクターで再生できます。それから3人称ブループリントでデフォルトのマネキンをキャラクターに入れ替えると、実際にレベルをモデルでプレイできます。

最後の仕上げは物理ボーンです。スケルトンの物理アセットを開き、ステージ9のオーバーコートのボーンに物理ボディを追加すると、キャラクターが走るときに布がモーションに反応するようになります。しっぽ、長いポニーテール、垂れたストラップなど、揺れる必要のあるすべてに同じセットアップです。UE5の物理アセットエディタがネイティブで処理し、追加プラグインは不要です。

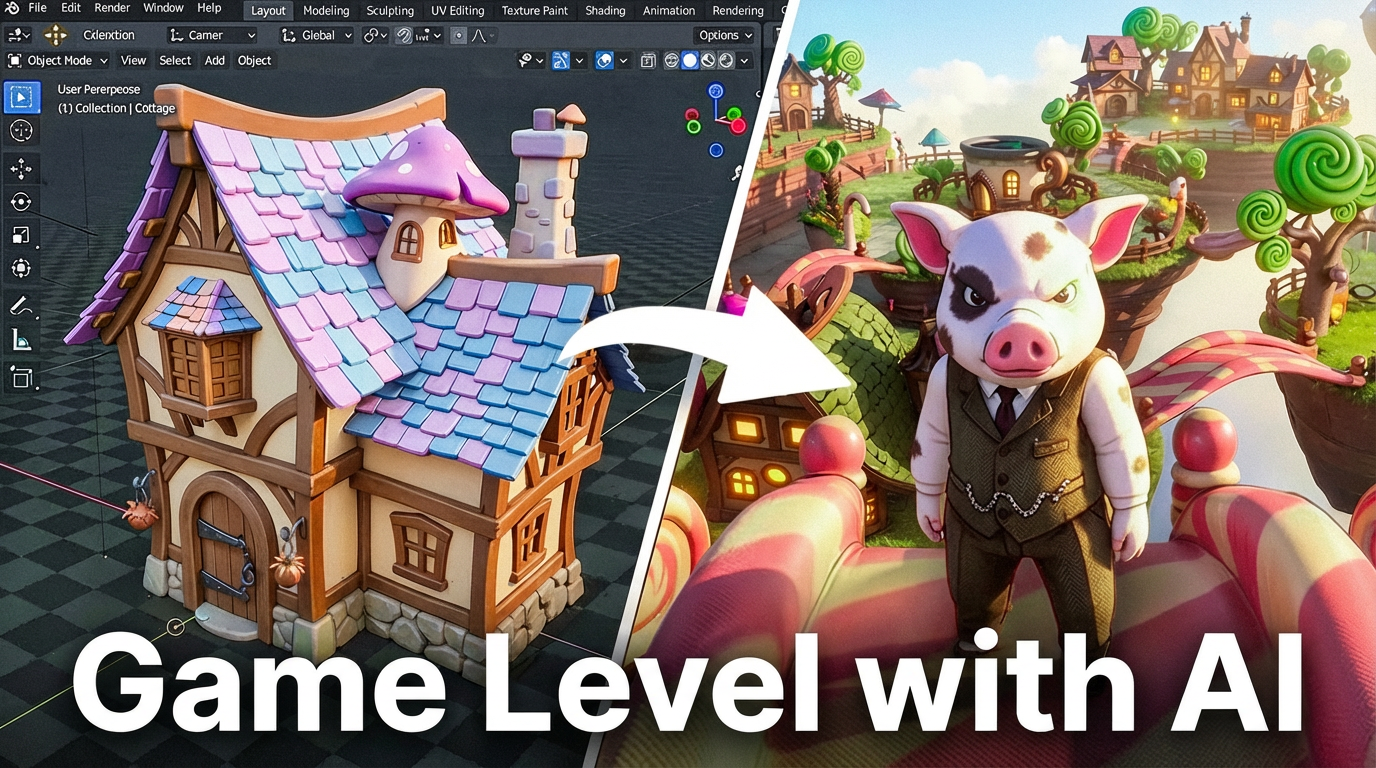

パイプラインの広範なUE5側(ノーコードワークフロー、車両アセット、フルレベル構築)には、3つの伴走ガイドがあります。 Aura UE5ノーコードワークフロー、 AIからUE5の運転可能な車まで、そして AIで1日でUE5ゲームレベルを構築する。

10/90ルール

従来のパイプラインの数字は 3DAI Studioの2026年プロダクションプロジェクト分析より:ゲームレディなキャラクターあたり40〜80時間。このパイプラインのAIベースメッシュステージは3〜5分かかります。アセット生成ステップだけで95〜98%の削減です。完全な10ステージパイプラインを足し合わせると、1〜2営業週ではなく1営業日になります。

これをやっていてもおかしいことはありません。同じ3DAI Studio調査によると、インディーゲームスタジオの67%は既にアセットにAI生成を使っています。AAAの89%はまだ伝統的モデリングを使っていますが、ハイブリッドワークフローは前年比140%で成長しています。重心は急速に動いています。

“私は最高のAIツールについての知識、3Dスキルの10%を渡します。それでどんな目標でも90%は達成できます。”

重要な10%:どのステージでどのAIツールに手を伸ばすかを知ること、Blenderでの基本的なメッシュ操作(Grab、Elastic Grab、マスキング、ウェイトペイント)、ベイク設定、UVシーム、AIアウトプットが十分良いか再生成すべきかを見極める判断力。90%は実際のプロダクション出力です。エンジン、ゲーム、映像、ポートフォリオに出荷される完成したキャラクター。何年もの習熟という要件はゲートキーパーであって、職人技の要件ではありませんでした。上記の10ステージパイプラインがその証拠です。

よくある質問

このパイプラインは本当に無料ですか、それとも隠れたコストがありますか?

この記事で紹介しているすべてのツール(Google AI Studio経由のNano Banana、Hunyuan 3D Studio 3.1、Blender、Retopoflow無料版、UV Packmaster、Modddif、ReallusionのAccuRig、ベイキング用のオプションのMarmoset Toolbag)には、キャラクターを完成させるのに十分な無料枠があります。従来の代替手段(ZBrush月額$49、Substance 3D月額$24.99、Maya年額$1,545)は、2026年5月時点で年間およそ$2,000になります。

このパイプラインで1キャラクターをエンドツーエンドで仕上げるのにどれくらいかかりますか?

コンセプトからUnreal Engineでリグ済みモデルになるまで、1キャラクターでおよそ1営業日です。AIベースメッシュのステージはHunyuan 3.1の生成1回あたり3〜5分ですが、最もきれいなワイヤーフレームを選ぶために3〜4回生成します。スカルプトのクリーンアップはおよそ1時間。UV展開、ベイキング、マップのコンポジットはトポロジーが固まればそれぞれ約30分。Modddifでのテクスチャリングは2〜3時間。リギングはシンプルなプロポーションなら30分から始まり、複雑なキャラクターではもっと長くかかります。

このパイプラインを使うのにBlenderの知識は必要ですか?

いいえ。必要なBlenderのツールはごく一部です。スカルプトモードのGrabとElastic Grab、基本的なUVシーム、Cyclesでのベイク設定、Principled BSDFのノードツリー、そしてウェイトペイントです。AIがベースメッシュ生成、リトポロジー、自動UV、リギングを処理します。Blenderは習得すべき技術ではなく、AIの仕上げツールになります。これが終盤で扱う10/90ルールの内容です。

なぜTripoやRodin、Meshyではなく、Hunyuan 3D 3.1を使うのですか?

Hunyuan 3.1は私がテストした中で最もきれいなクアッドベースのワイヤーフレームを生成し、リトポロジーの工程が短くなります。Tripoは高速でデフォルトのテクスチャも優れていますが、メッシュの品質にばらつきが大きいです。Rodin Gen-2はスカルプトや3Dプリント用途には良いですが、ゲームレディの用途ではクリーンアップが重くなります。詳細なデータは私たちの リトポロジーテストの並列比較を参照してください。

リグ済みのキャラクターは実際にアニメーションするのか、それともUnreal Engineで壊れますか?

この記事でレンダリングしたPlague Doctorキャラクターは、Unreal Engine 5でクリッピングやTポーズのドリフトなしにアニメーションパスを通ります。これはほとんどのAI 3Dデモワークフローを篩い落とすテストです。AccuRigのマーカー+キャリブレーション+30分のBlenderウェイトペイントが、静止レンダーだけでなく実際のアニメーションに耐えるキャラクターを作る部分です。UE5のManny/Queenieスケルトンからのリターゲティングがロコモーションセットを処理します。

ノーマルマップとAOマップは自分でベイクする必要がありますか、それともスキップできますか?

ベイクをスキップするのは、ハイポリのディテールを失う最速の方法です。AIツールは単体で見れば素晴らしいが、リアルタイムエンジンには重すぎる密なメッシュを生成します。ベイキングはそのディテールをノーマルマップとAOマップに転写し、ローポリ版がすべてのシワや折り目を持っているように見せます。私の考えでは、ベイキングはソフトウェア(Blender CyclesかMarmoset Toolbag)の中で完結させるのが理にかなう唯一のステップです。私の見解:“CGIにおいて、アンビエントオクルージョンは色テクスチャがなくてもオブジェクトをリアルに見せられるので私のお気に入りのマップです。”

ツールは毎週変わります。だからこそ私たちは arenaでブラインド比較を行い、 leaderboardに進行中の結果を公開しています。何か特定のものについて次のステップが欲しい場合(テクスチャリング、リギング、フルUE5受け渡し)、 /learnのアーカイブに上記の各ステージと対になる詳細解説があります。

Stefan Vaskevich

Stefan Vaskevich